Was ist ein Entscheidungsbaum?

Ein Entscheidungsbaum, auch als Decision Tree bekannt, ist eine grafische Darstellung der möglichen Ergebnisse bzw. Auswirkungen einer Reihe zusammenhängender Entscheidungen. Entscheidungsbäume ermöglichen es Unternehmen oder Einzelpersonen, verschiedene Lösungsansätze und Entscheidungsmöglichkeiten im Hinblick auf Kosten, Wahrscheinlichkeit und Vorteile miteinander zu vergleichen. Sie können als Ausgangspunkt für informelle Diskussionen oder zum Entwickeln eines mathematischen Algorithmus zum Vorhersagen der besten Option verwendet werden.

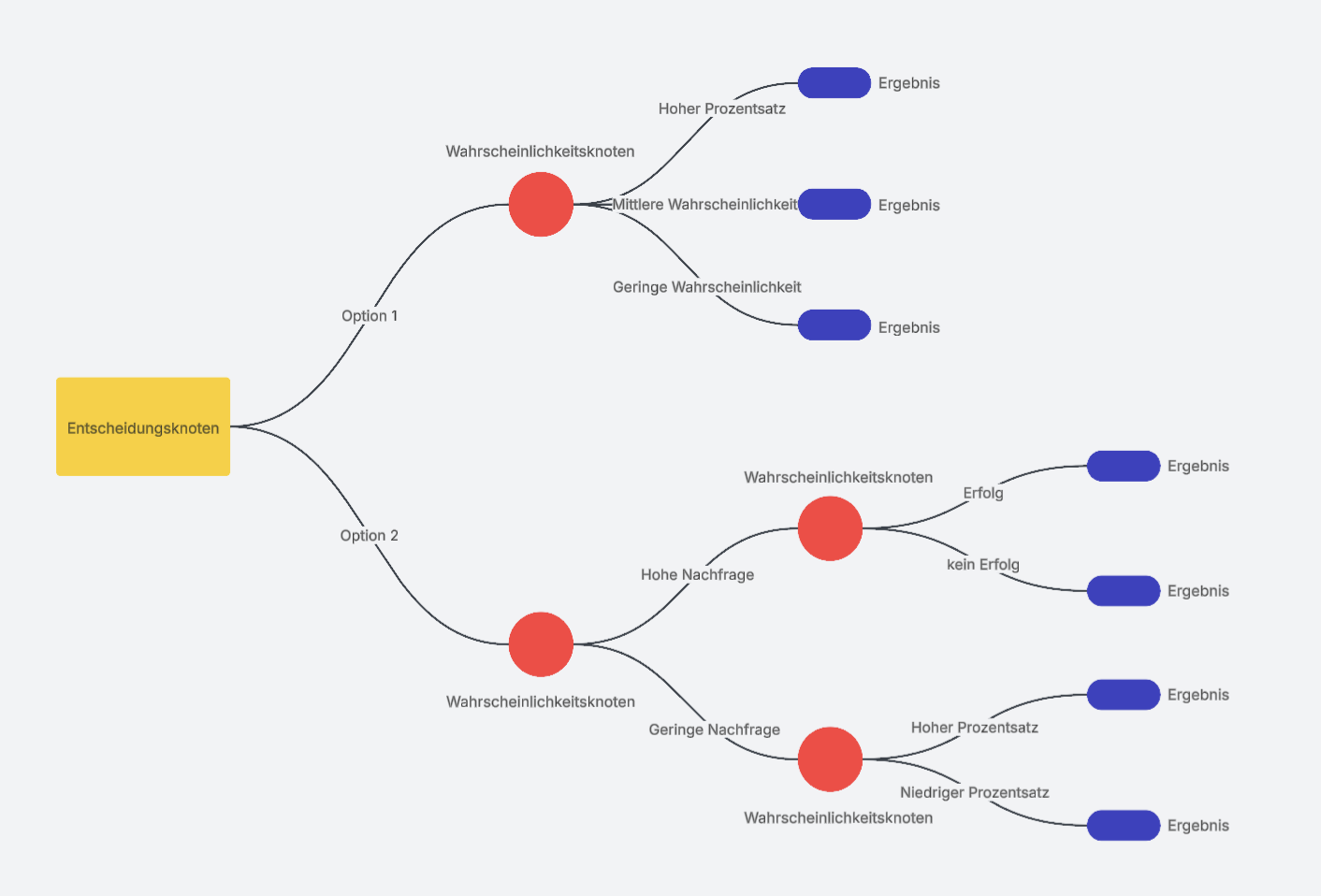

Ein Entscheidungsbaum beginnt in der Regel mit einem einzelnen Knoten, vom dem Verzweigungen ausgehen, welche die jeweiligen Auswirkungen bzw. Ergebnisse der betreffenden Entscheidung darstellen. Jedes Ergebnis ist mit weiteren Knoten verbunden, die wiederum weitere mögliche Auswirkungen nach sich ziehen. So entsteht eine baumartige Form.

Es gibt drei verschiedene Arten von Knoten: Zufallsknoten, Entscheidungsknoten und Endknoten. Ein Zufallsknoten wird als Kreis dargestellt und zeigt, wie wahrscheinlich bestimmte Ergebnisse bzw. Auswirkungen sind. Ein Entscheidungsknoten wird in Form eines Quadrats dargestellt und repräsentiert eine zu treffende Entscheidung, während ein Endknoten das Endergebnis einer Reihe aufeinanderfolgender Entscheidungen zeigt.

Entscheidungsbäume können auch mit Flussdiagramm-Symbolen gezeichnet werden, was oft als leserfreundlicher und leichter verständlich empfunden wird.

Erste Schritte mit Lucidchart in weniger als 5 Minuten

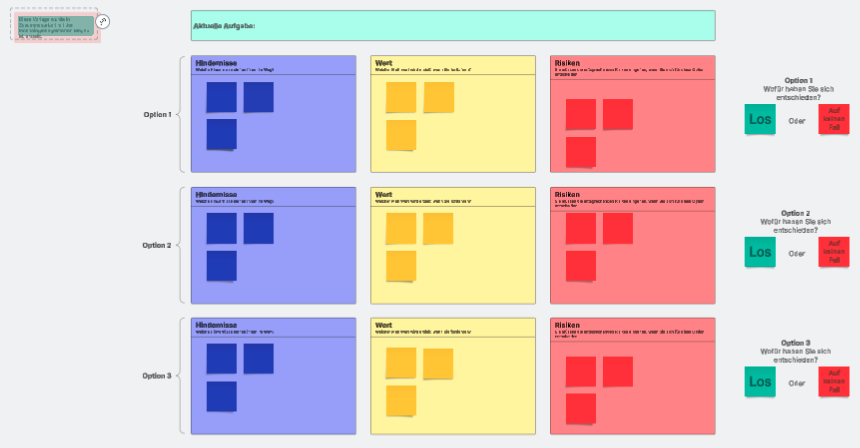

- Zeichnen Sie Ihren ersten Entscheidungsbaum, Baumdiagramm, Decision Tree, oder anderen Namen, welchen Sie für diese Art von Diagramm bevorzugen, basierend auf einer unserer fertigen Vorlagen, erstellen Sie es von Grund auf neu, oder nutzen Sie die Dokumentimportfunktion.

- Fügen Sie Formen, Verbindungslinien und Text hinzu um Ihre Diagramme robuster zu machen.

Passen Sie Farben und Format Ihrer Entscheidungsbaumdiagramme nach Ihren Bedürfnissen an, um diese noch lesbarer und visuell ansprechender zu gestalten. - Lokalisieren Sie benötigte Elemente mit der Suchfunktion.

- Teilen Sie Diagramme mit Ihrem Team und beginnen Sie sofort mit der Zusammenarbeit.

Wann wird eine Entscheidungsbaumanalyse verwendet?

Entscheidungen, Entscheidungen ... wir alle sehen uns mit ihnen konfrontiert. Wenn ein Unternehmen eine falsche Entscheidung trifft, kann sich das als kostspieliger Fehler mit finanziellen Verlusten, schlechtem Ressourceneinsatz und negativen Auswirkungen auf die Firmenreputation erweisen. Zum Glück gibt es Entscheidungsbaum-Diagramme! Obwohl solche Diagramme keine Kristallkugeln sind, können Sie Ihnen wertvolle Erkenntnisse liefern, mit denen Sie die richtige Richtung einschlagen können. Einer der größten Vorteile eines Entscheidungsbaums ist die Tatsache, dass damit Emotionen aus dem Spiel genommen werden.

Entscheidungsbaum-Diagramme werden oft von Firmen verwendet, um eine Strategie zu planen, Forschungsergebnisse zu analysieren und Schlüsse zu ziehen. Kreditgeber und Banken nutzen Entscheidungsbäume, um das Risiko von Darlehen und Investment-Möglichkeiten zu bewerten. Außerdem sind sie ein beliebtes Mittel für Infografiken, die dann in Zeitschriften auftauchen oder in den sozialen Medien geteilt werden. Entscheidungsbäume können zur Bewertung fast jeder Frage oder Sorge und zur Visualisierung möglicher Ergebnisse genutzt werden.

Aufbau von einem Entscheidungsbaum

Das Schöne an Entscheidungsbaumdiagrammen, oder Baumdiagrammen, ist, dass es nicht besonders viele verschiedene Elemente gibt. Die wichtigsten Elemente werden Knoten genannt und als Quadrat oder Kreis mit Abzweigungen (Linien) dargestellt, welche die Knoten bis zum Endergebnis verbinden. Quadrate stehen für Entscheidungen, Kreise für ungewisse Ergebnisse.

Knoten verfügen über mindestens zwei Abzweigungen. Auf jeder Linie steht eine mögliche Lösung, die diese mit dem nächsten Knoten verbindet. Diese Vorgehensweise setzt sich fort, bis alle Möglichkeiten erschöpft sind. Am Schluss steht ein Dreieck, welches das Ergebnis darstellt.

Sobald Sie die grundlegende Struktur eines Entscheidungsbaums entwickelt haben, können Sie zu jeder Linie Werte hinzufügen, um mehr Informationen zu sammeln. Das geht so:

1. Sehen Sie sich jede Linie an und fügen Sie jeweils eine Menge hinzu.

2. Zur numerischen Analyse Ihrer Optionen fügen Sie eine Wahrscheinlichkeitsschätzung für jedes Ergebnis hinzu. Hinweis: Wenn Sie mit Prozentsätzen rechnen, müssen die Abzweigungen von einem Knoten zusammen 100 ergeben, bei Brüchen muss eine Summe von 1 herauskommen.

3. Weisen Sie jedem Dreieck am Ende der Abzweigungen eine mögliche Menge zu.

4. Berechnen Sie die Ergebnisse, indem Sie das Ergebnis mit der Wahrscheinlichkeit in Prozent für jede Abzweigung mit Ende im Ergebnis multiplizieren und die Kosten für diese Vorgehensweise abziehen. Sie erhalten eine Schätzung des möglichen Ertrags dieses speziellen Ergebnisses.

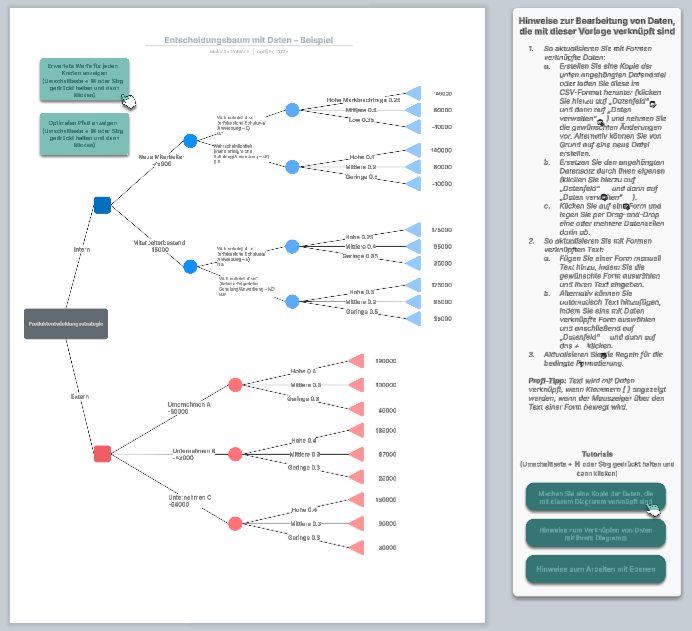

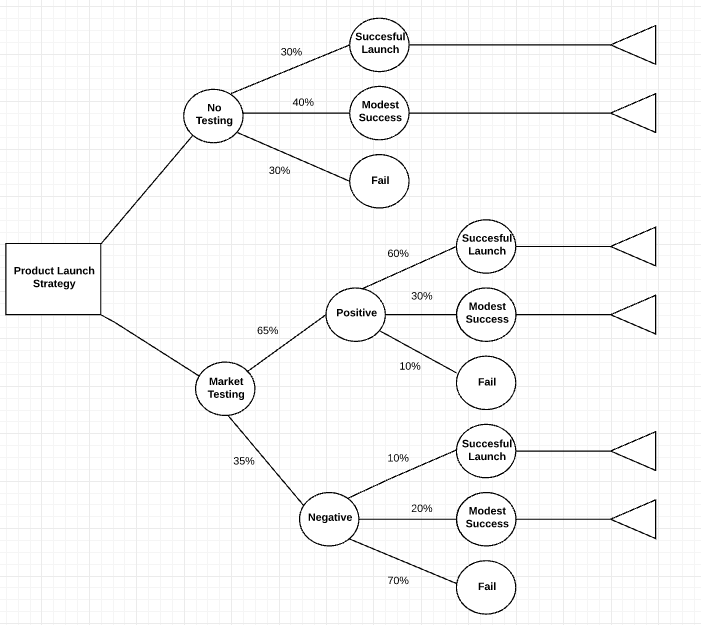

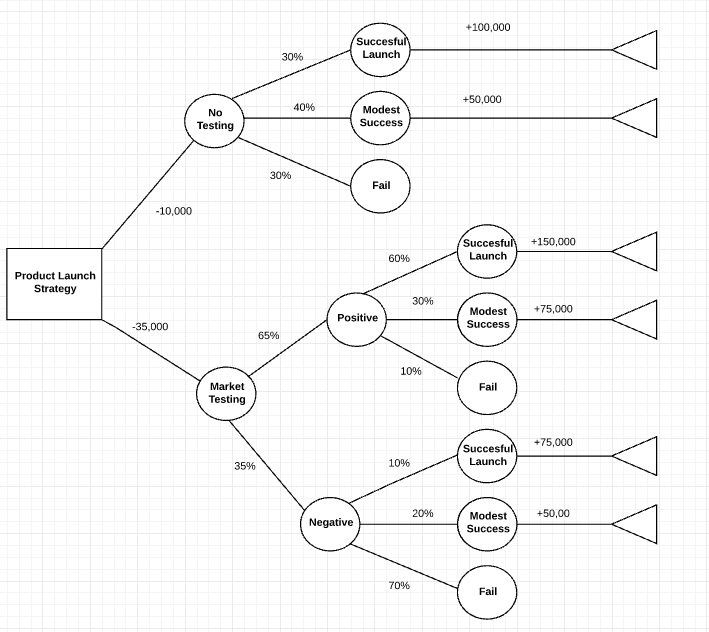

Hier ist ein Beispiel:

Hinweis: Wenn Sie einen großen Entscheidungsbaum mit vielen Abzweigungen haben, sollten Sie die Zahlen für jedes Quadrat und jeden Kreis berechnen und dann die Ergebnisse aufzeichnen, um den Wert dieser Entscheidung abzuleiten. Fangen Sie auf der rechten Seite des Baums an und arbeiten Sie sich nach links vor.

Vor- und Nachteile von Baumdiagrammen

Entscheidungsbäume erfreuen sich aus vielerlei Gründen nach wie vor großer Beliebtheit:

- Sie sind leicht verständlich

- Sie sind sowohl mit als auch ohne konkrete Daten nützlich und Daten können ohne viel Vorbereitung erhoben werden

- Neue Optionen lassen sich problemlos zu bestehenden Entscheidungsbäumen hinzufügen

- Sie ermöglichen es, aus verschiedenen Entscheidungsmöglichkeiten die beste auszuwählen

- Sie lassen sich problemlos mit anderen Tools zur Entscheidungsfindung kombinieren

Auf der anderen Seite kann es durchaus vorkommen, dass Entscheidungsbäume zu komplex werden. In solchen Fällen empfiehlt es sich, stattdessen Einflussdiagramme zu verwenden, da diese es ermöglichen, Informationen kürzer und knapper darzustellen als Entscheidungsbäume. Das liegt daran, dass sie sich auf kritische Entscheidungen, Inputs und Ziele konzentrieren.

Fallbeispiel: Analyse mit Entscheidungsbäumen

Indem Sie den Nutzen oder Mehrwert jeder möglichen Entscheidung innerhalb des Diagramms berechnen, können Sie Ihre Risiken auf ein Minimum reduzieren und gleichzeitig die Wahrscheinlichkeit eines positiven Ergebnisses maximieren.

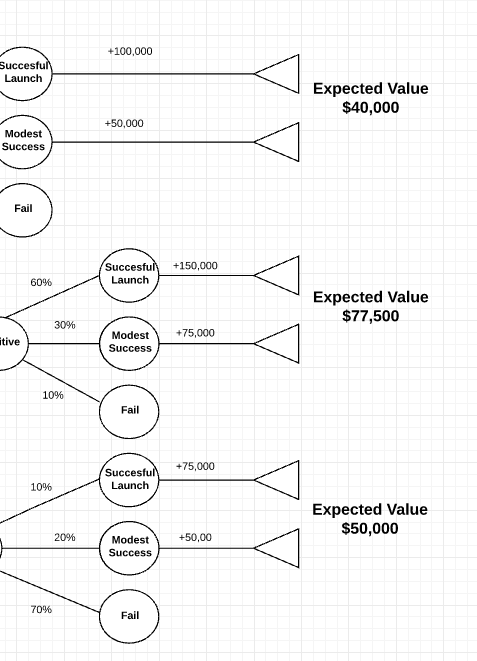

Um den voraussichtlichen Nutzen einer Entscheidung zu ermitteln, wägen Sie einfach die Kosten dieser Entscheidung gegen die erwarteten positiven Auswirkungen ab. Die erwarteten positiven Auswirkungen einer Entscheidung entsprechen dem Gesamtwert sämtlicher potenzieller Ergebnisse der jeweiligen Entscheidung, wobei jeder Einzelwert mit der Wahrscheinlichkeit, mit der das betreffende Ergebnis eintreten wird, multipliziert wird. Für das oben genannte Beispiel würden wir diese Werte wie folgt berechnen:

Bei der Ermittlung des bestmöglichen Ergebnisses ist es äußerst wichtig, die Präferenzen des Entscheidungsträgers zu berücksichtigen. Zum Beispiel bevorzugen manche eventuell Optionen, die nur mit geringen Risiken verbunden sind, während andere wiederum bereit sind, größere Risiken einzugehen, wenn die Aussicht auf einen größeren Nutzen besteht.

Wenn Sie zusätzlich zu Ihrem Entscheidungsbaum ein Wahrscheinlichkeitsmodell verwenden, können Sie die bedingte Wahrscheinlichkeit eines Ereignisses (das heißt, wie gut die Chancen stehen, dass ein Ereignis eintritt, falls zunächst ein anderes Ereignis eintritt) berechnen. Starten Sie hierzu einfach mit dem ersten Ereignis und bauen Sie Ihr Diagramm aus, bis Sie beim gewünschten Zielereignis angekommen sind. Multiplizieren Sie dann die Wahrscheinlichkeit sämtlicher im Diagramm eingetragenen Ereignisse miteinander.

In diesem Sinne können Entscheidungsbäume wie herkömmliche Baumdiagramme verwendet werden. Letztere stellen die Wahrscheinlichkeit bestimmter Ereignisse dar – zum Beispiel, dass eine Münze zweimal hintereinander auf Kopf bzw. Zahl landet.

Entscheidungsbäume im Bereich des maschinellen Lernens und des Data-Mining

Ein Entscheidungsbaum kann auch beim Entwickeln automatisierter Prognosemodelle helfen, die in den Bereichen maschinelles Lernen, Data-Mining und Statistik Anwendung finden. Diese Methode, die als Entscheidungsbaum-Lernen bezeichnet wird, berücksichtigt unterschiedliche Aspekte eines Elements, um dessen Wert einzuschätzen.

Bei diesen Entscheidungsbäumen repräsentieren Knoten keine Entscheidungen, sondern Daten. Man spricht in diesem Zusammenhang auch von Klassifikationsbäumen. Jede Verzweigung enthält eine Reihe von Attributen bzw. Klassifizierungsregeln, die mit einer bestimmten Klassenbezeichnung am Ende der Verzweigung zusammenhängen.

Diese Regeln, die auch als Entscheidungsregeln bezeichnet werden, können in Form einer „Wenn-dann“-Klausel ausgedrückt werden, wobei jede Entscheidung bzw. jeder Datenwert einer Klausel entspricht, wie zum Beispiel: „Wenn Bedingungen 1, 2 und 3 erfüllt werden, dann tritt Ereignis X mit einer Wahrscheinlichkeit von Y ein.“

Jeder weitere Datensatz hilft dem Modell, präziser vorherzusagen, zu welchem Wertesatz innerhalb einer begrenzten Sammlung an Wertesätzen das betreffende Subjekt gehört. Diese Informationen können anschließend in einen größeren Entscheidungsbaum eingefüttert werden.

In manchen Fällen handelt es sich bei dem Prognosewert um eine tatsächliche Zahl mit Realitätsbezug, wie etwa um einen Preis. Entscheidungsbäume, die kontinuierliche und unendliche viele mögliche Auswirkungen bzw. Ergebnisse darstellen, nennt man Regressionsbäume.

Um eine möglichst hohe Genauigkeit zu erzielen, werden mitunter mehrere Entscheidungsbäume – sogenannte Entscheidungswälder – verwendet:

- Bagging erstellt durch erneutes Sampling der Quelldaten mehrere Entscheidungsbäume, die dann automatisch gegeneinander gewichtet werden, um zu einem Ergebnis zu kommen.

- Ein Random Forest-Klassifikator besteht aus mehreren Entscheidungsbäumen, um so die Klassifikationsrate zu steigern.

- Boosted Trees können für Regressions- und Klassifikationsbäume verwendet werden.

- Die Bäume innerhalb eines sogenannten Rotation Forest (auch als zufällige Unterräume bezeichnet) basieren auf einem Verfahren, bei dem das Prinzip der Hauptkomponentenanalyse auf einen zufälligen Datenbereich angewendet wird.

Ein optimaler Entscheidungsbaum repräsentiert möglichst viele Daten mit möglichst wenigen Ebenen oder Fragen. Einige Algorithmen, die mit dem Ziel entwickelt wurden, optimierte Entscheidungsbäume zu erstellen, sind etwa CART, ASSISTANT, CLS und ID3/4/5. Entscheidungsbäume können auch auf Basis von Assoziationsregeln erstellt werden. Hierbei wird die Zielvariable rechts dargestellt.

Unabhängig von der Methode muss auf jeder Ebene ermittelt werden, wie die Daten aufgespaltet werden sollen. Gängige Methoden in diesem Zusammenhang bestehen etwa im Messen des Gini-Koeffizienten, des Informationsgewinns und der Varianzreduktion.

Die Anwendung von Entscheidungsbäumen im Bereich des maschinellen Lernens hat verschiedene Vorteile:

- Mit jedem weiteren Datenpunkt sinken die Kosten, die bei der Datenprognose mithilfe des Entscheidungsbaums anfallen

- Sowohl für kategorische als auch für numerische Daten geeignet

- Kann Probleme mit mehreren Outputs modellieren

- Verwendet ein White-Box-Modell (sodass Ergebnisse sich leicht erklären lassen)

- Die Zuverlässigkeit eines Entscheidungsbaums lässt sich messen und bewerten

- Entscheidungsbäume liefern in der Regel zuverlässige Ergebnisse, selbst wenn sie den Annahmen der Quelldaten widersprechen

Allerdings bergen Entscheidungsbäume auch eine Reihe von Nachteilen:

- Im Falle kategorischer Daten mit mehreren Ebenen werden im Rahmen des Informationengewinns die Attribute mit den meisten Ebenen vorrangig gewertet.

- Berechnungen werden zunehmend schwieriger, wenn Unsicherheiten oder eine hohe Anzahl an miteinander verbundenen Auswirkungen bzw. Ergebnissen vorliegt.

- Verbindungen zwischen Knoten sind auf „UND“-Klauseln begrenzt, während Entscheidungsdiagramme auch „ODER“-Klauseln zulassen.

Gängige Symbole von einem Entscheidungsbaum

| Form | Name | Bedeutung |

|---|---|---|

| Entscheidungsknoten | Repräsentiert eine zu treffende Entscheidung |

| Zufallsknoten | Repräsentiert mehrere ungewisse Ergebnisse |

| Alternative Verzweigungen | Jede Verzweigung steht für ein mögliches Ergebnis oder eine mögliche Maßnahme |

| Abgelehnte Alternative | Repräsentiert eine Option, die nicht gewählt wurde |

| Endknoten | Repräsentiert ein Endergebnis |

Anleitung zum Entscheidungsbaum Zeichnen

Legen Sie zunächst fest, wie Sie Ihren Entscheidungsbaum erstellen wollen. Sie können das Diagramm von Hand auf Papier oder eine Tafel zeichnen oder speziell für diesen Zweck entwickelte Software verwenden. In beiden Fällen müssen Sie diese Schritte befolgen:

1. Beginnen Sie mit der wichtigsten Entscheidung. Zeichnen Sie ein kleines Kästchen ein, um diesen Punkt darzustellen, und ziehen Sie dann von diesem Kästchen aus eine Linie für jede mögliche Lösung oder Maßnahmen. Letztere sollten entsprechend beschriftet werden.

2. Bauen Sie den Entscheidungsbaum aus, indem Sie Zufalls- und Entscheidungsknoten folgendermaßen hinzufügen:

- Zeichnen Sie ein weiteres Kästchen ein, falls eine weitere Entscheidung notwendig ist.

- Zeichnen Sie einen Kreis ein, wenn das Ergebnis ungewiss ist (Kreise stehen für Zufallsknoten).

- Ist das Problem gelöst, brauchen Sie (fürs Erste) nichts weiter hinzuzufügen.

Verbinden Sie jeden Entscheidungsknoten mit möglichen Lösungen. Ziehen Sie von jedem Zufallsknoten aus Linien, die mögliche Ergebnisse bzw. Auswirkungen darstellen. Wenn Sie Ihre Optionen numerisch analysieren möchten, sollten Sie die Wahrscheinlichkeit jedes Ergebnisses sowie die Kosten jeder Maßnahme vermerken.

3. Bauen Sie den Entscheidungsbaum so lange weiter aus, bis jede Linie an einen Endpunkt gelangt– das heißt, bis es keine weiteren Entscheidungen zu treffen gibt und keine weiteren Ergebnisse bzw. Auswirkungen mehr möglich sind. Ordnen Sie dann jedem möglichen Ergebnis einen bestimmten Wert zu. Dabei kann es sich um eine abstrakte Bewertung oder um einen finanziellen Wert handeln. Fügen Sie Dreiecke hinzu, um die Endpunkte zu repräsentieren.

Nun, da Sie einen Entscheidungsbaum erstellt haben, können Sie mit der Analyse der betreffenden Entscheidung beginnen.

Entscheidungsbaum erstellen mit Lucidchart

Verwenden wir Lucidchart, um einen Entscheidungsbaum für eine Produkteinführung zu erstellen. Damit können wir analysieren, ob sich die Investition in eine Marktsondierung lohnt. Es gibt nur wenige Symbole in einem Entscheidungsbaum (Kreis, Quadrat, Linie und Dreieck), daher brauchen wir keine Vorlage. Melden Sie sich bei Ihrem Konto an (oder registrieren Sie sich kostenlos für ein einwöchiges Lucidchart Probeabo) und befolgen Sie die weiteren Schritte.

1. Öffnen Sie ein leeres Dokument

Klicken Sie im Abschnitt „Dokumente“ auf die orangefarbene Schaltfläche „+Dokument“ und doppelklicken Sie darauf.

Tipp: Sie können auch auf den orangefarbenen Pfeil nach unten klicken und eine leere Diagrammvorlage auswählen. Wenn Sie diese Option nutzen, können Sie gleich mit Schritt 3 weitermachen.

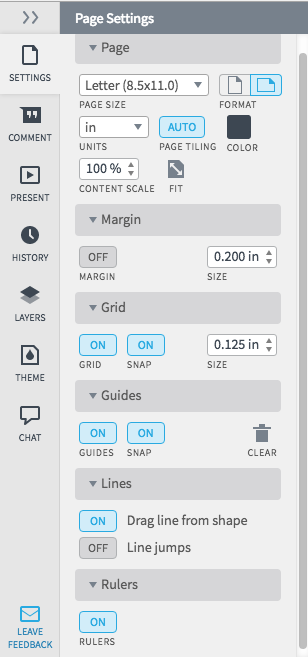

2. Passen Sie die Seiteneinstellungen an

Wenn Sie ein leeres Dokument anstelle einer Vorlage öffnen, können Sie die Seiteneinstellungen, Ränder, Führungslinien, Raster, Zeilen und Lineale anpassen. Rechts sehen Sie das Menü Seiteneinstellungen, in dem Sie viele Einstellungen vornehmen können. Klicken Sie einfach auf die gewünschten Optionen. Wenn Sie fertig sind, klicken Sie auf die Pfeile neben „Seiteneinstellungen“, um das Menü auszublenden. Da Entscheidungsbäume schnell einen recht großen Umfang annehmen können, ändern wir die Seite auf Querformat.

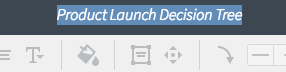

3. Benennen Sie das Entscheidungsbaum-Diagramm

Klicken Sie auf die Überschrift „Leeres Diagramm“ oben auf dem Bildschirm und geben Sie einen Namen für die Datei ein.

Hinweis: Wenn Sie eine Vorlage auswählen, wird ein Pop-up-Fenster geöffnet, in dessen Textfeld Sie den Namen Ihres Diagramms eingeben können. Klicken Sie anschließend auf „OK“. Der neue Name wird oben links auf dem Bildschirm angezeigt.

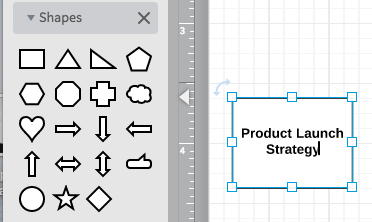

4. Zeichnen Sie Ihren Entscheidungsbaum

Klicken und halten Sie das Rechteck unter Formen gedrückt; ziehen Sie es ganz nach links im Dokument. Entscheidungsbäume werden von links nach rechts gezeichnet. Platzieren Sie das Rechteck also so dicht wie möglich am Seitenrand. Mithilfe des Rasters und der Lineale können Sie das Rechteck ausrichten. Geben Sie die Entscheidung in das Rechteck ein.

Tipp: Mit den Textformatierungsoptionen oben im Diagramm können Sie Schriftart, Farben, Zeilenabstand usw. anpassen.

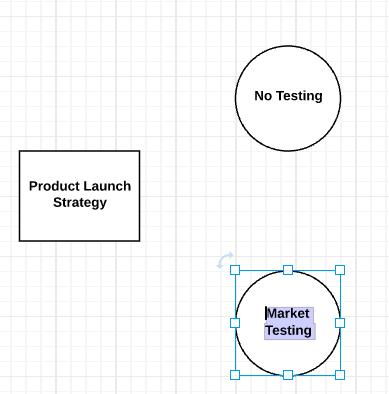

5. Fügen Sie Knoten hinzu

Klicken und ziehen Sie einen Kreis in das Diagramm, um einen ungewissen Knoten hinzuzufügen. Richten Sie die Kreise am Raster auf der Seite aus. Zur Anpassung der Kreisgröße klicken Sie darauf und anschließend auf ein blaues Kästchen, um daran zu ziehen und die Größe anzupassen. Geben Sie den Namen des ungewissen Ergebnisses in den Kreis ein.

Sie können so viele Möglichkeiten hinzufügen, wie Sie möchten, aber für einen Entscheidungsbaum brauchen Sie mindestens zwei Optionen. Fügen Sie weitere Knoten zum Entscheidungsbaum hinzu, bis Sie das Endergebnis für jede Wahlmöglichkeit erreicht haben.

Tipp: Wenn Sie nicht jeden Knoten (Kreis) einzeln vergrößern/verkleinern wollen, klicken Sie einfach auf einen beliebigen Kreis und drücken Sie die Befehlstaste + C auf der Tastatur. Drücken Sie dann die Befehlstaste + V, um eine Kopie dieses Kreises einzufügen; anschließend können Sie diesen an die gewünschte Position ziehen.

6. Fügen Sie Abzweigungen zum Entscheidungsbaum hinzu

Klicken Sie auf eine Form und klicken und halten Sie anschließend einen der orangefarbenen Kreise gedrückt, um eine Linie von diesem zum nächsten Knoten zu ziehen. Es wird automatisch ein Pfeil zwischen den beiden Objekten gezeichnet.

Tipp: Wählen Sie in der obersten Menüleiste aus der Endpunkt-Option den Eintrag „Keine Spitze“, um die Pfeilspitze von der Linie zu entfernen.

Wenn Sie das Ende einer Abzweigung erreicht haben und keine weiteren Entscheidungen nötig sind, fügen Sie diesem Pfad ein Dreieck hinzu.

7. Fügen Sie Wahrscheinlichkeiten und Werte zum Entscheidungsbaum hinzu

Es ist Zeit, den Entscheidungsbaum zu bewerten, um einzuschätzen, wie viel ein bestimmtes Ergebnis wert ist. Sehen Sie sich die Kreise an und fügen Sie Schätzungen für die Wahrscheinlichkeit der jeweiligen Ereignisse hinzu. Wenn Sie Zahlen zum Diagramm hinzufügen möchten, klicken Sie auf das große T in den Standardoptionen und ziehen Sie es an die Stelle, an der Sie eine Schätzung hinzufügen möchten.

Hinweis: Die Prozentsätze für einen Knoten müssen zusammen 100 ergeben, bei Brüchen muss die 1 herauskommen. Wenn Sie bereits Daten haben, können Sie diese verwenden.

Dann fügen Sie die Kosten der jeweiligen Option entlang der Abzweigung (Entscheidungslinie) ein.

8. Berechnen Sie den Wert der einzelnen Entscheidungen

Fangen Sie auf der rechten Seite des Baums an und arbeiten Sie sich nach links vor. Ziehen Sie die Kosten der jeweiligen Entscheidung von den zu erwartenden Vorteilen ab.

Sobald die Berechnungen abgeschlossen sind, sehen Sie ganz genau, welche Option Ihnen die größten Vorteile bietet.

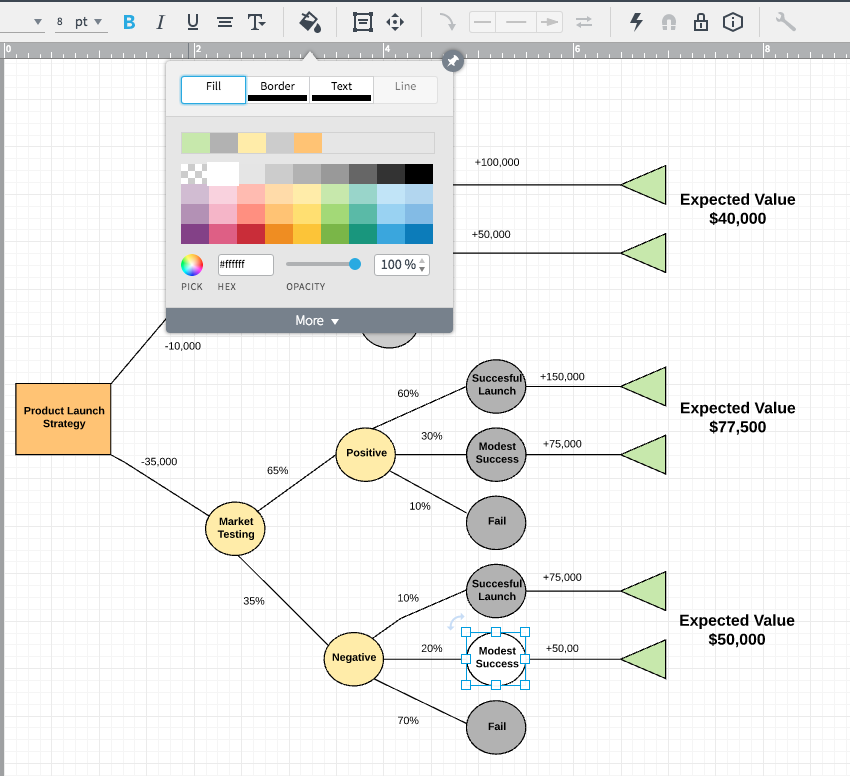

9. Fügen Sie Farben zum Entscheidungsbaum hinzu

Sobald Sie das grundlegende Design Ihres Entscheidungsbaums abgeschlossen haben, können Sie Farbe ins Spiel bringen. Klicken Sie dazu auf eine Form und dann auf das Farbfüller-Symbol in der Menüleiste, um eine Farbe auszuwählen.

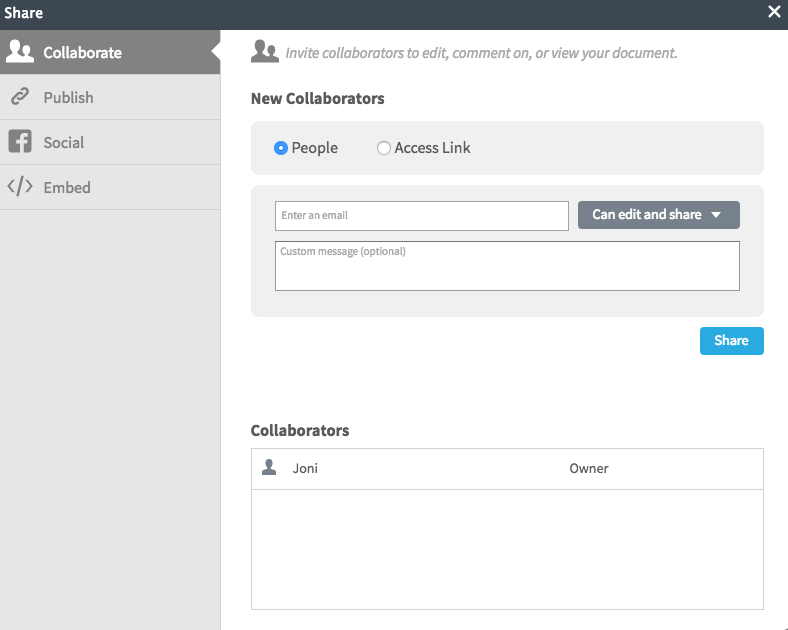

10. Teilen Sie Ihr Entscheidungsbaumdiagramm

Sobald Sie mit Ihrem Entscheidungsbaum zufrieden sind, können Sie ihn mit anderen über E-Mail, Web-Link, soziale Medien (Facebook, Twitter, Google+ und LinkedIn) teilen oder ihn auf einer Website einbetten. Klicken Sie auf die blaue „Teilen“-Schaltfläche oben rechts auf dem Bildschirm, um ein Pop-up-Fenster aufzurufen. Wählen Sie aus, wie Sie das Diagramm teilen möchten, und machen Sie die entsprechenden Angaben.

Wenn Sie einen Mitwirkenden hinzufügen (per E-Mail einen Link zum Entscheidungsbaum schicken), können Sie gleichzeitig am Diagramm arbeiten und sich über die Chatfunktion absprechen.