¿Qué es un árbol de decisión?

Un árbol de decisión es un mapa de los posibles resultados de una serie de decisiones relacionadas. Permite que un individuo o una organización comparen posibles acciones entre sí según sus costos, probabilidades y beneficios. Se pueden usar para dirigir un intercambio de ideas informal o trazar un algoritmo que anticipe matemáticamente la mejor opción.

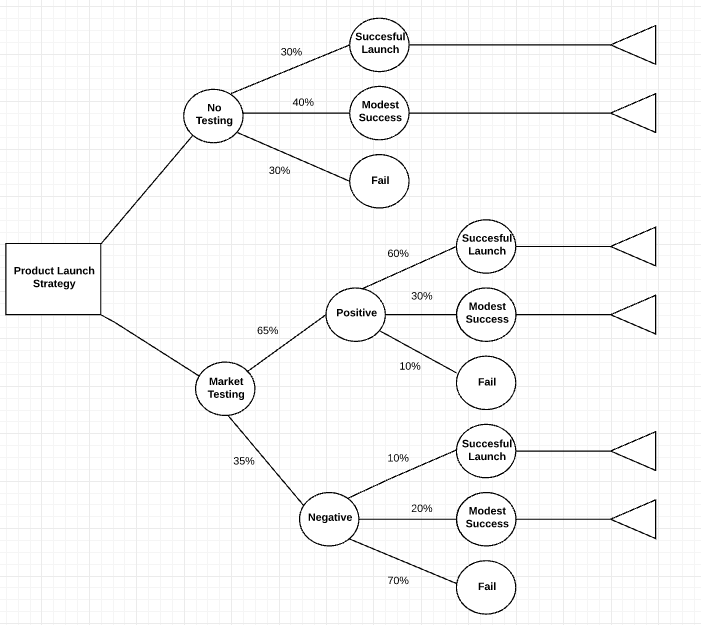

Un árbol de decisión, por lo general, comienza con un único nodo y luego se ramifica en resultados posibles. Cada uno de esos resultados crea nodos adicionales, que se ramifican en otras posibilidades. Esto le da una forma similar a la de un árbol.

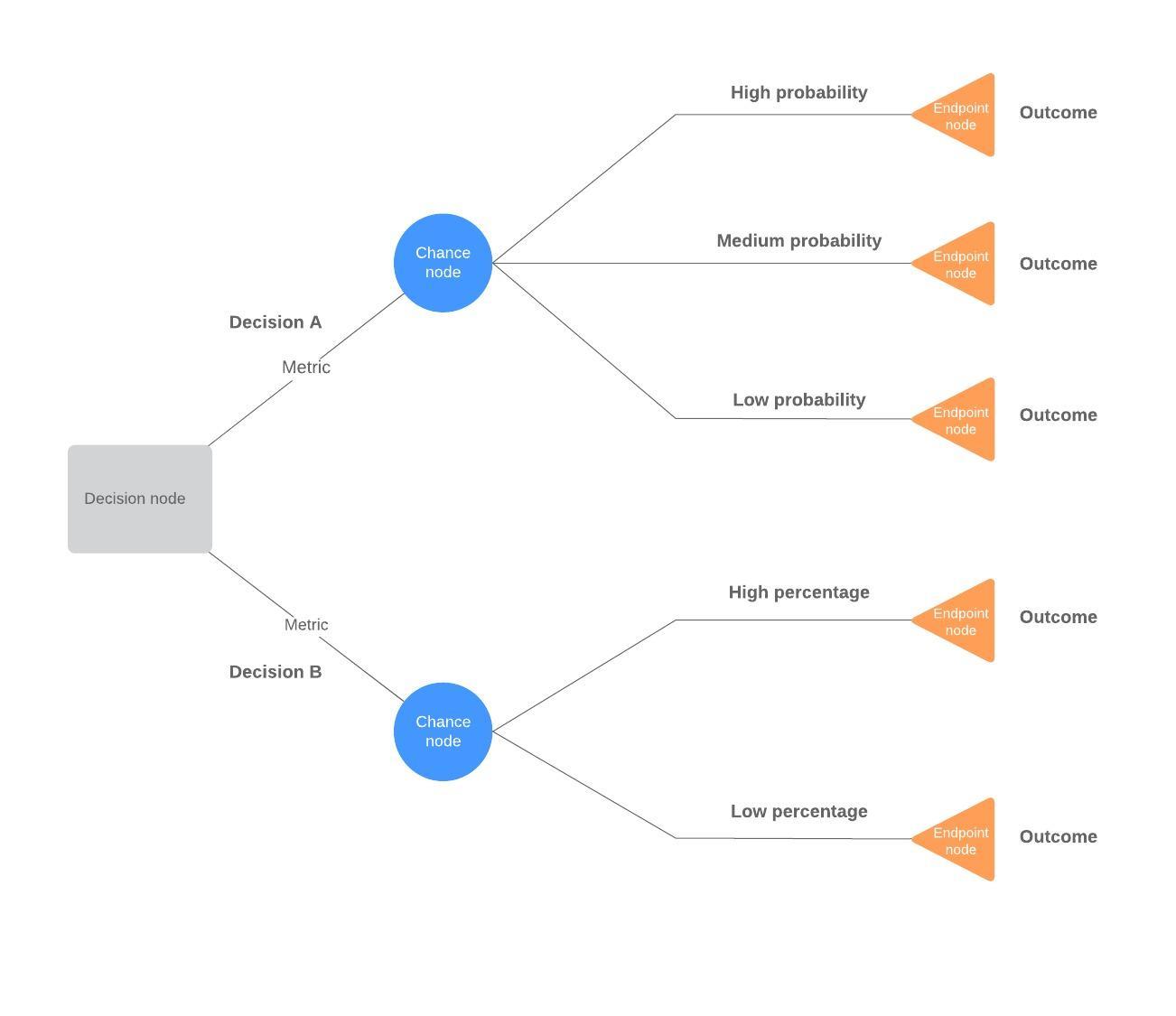

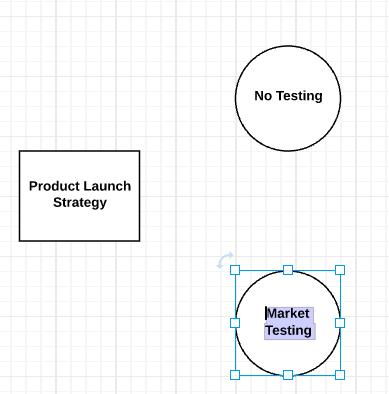

Hay tres tipos diferentes de nodos: nodos de probabilidad, nodos de decisión y nodos terminales. Un nodo de probabilidad, representado con un círculo, muestra las probabilidades de ciertos resultados. Un nodo de decisión, representado con un cuadrado, muestra una decisión que se tomará, y un nodo terminal muestra el resultado definitivo de una ruta de decisión.

Los árboles de decisión también se pueden dibujar con símbolos de diagramas de flujo, que a algunas personas les parecen más fáciles de leer y comprender.

Domina los conceptos básicos de Lucidchart en 3 minutos

- Crea tu primer árbol de decisiones a partir de una plantilla o un lienzo en blanco o importa un documento.

- Agrega texto, figuras y líneas para personalizar tu diagrama.

- Aprende cómo ajustar el estilo y el formato.

- Localiza lo que necesitas con la búsqueda de funciones.

- Comparte tu diagrama con tu equipo para empezar a colaborar.

¿Para qué sirve los árboles de decisiones?

Las decisiones... Todos tenemos que tomarlas. Cuando un negocio toma la decisión incorrecta, puede cometer un error costoso que cause una pérdida financiera, un mal uso de los recursos y un impacto negativo en la imagen de la empresa. Afortunadamente, un diagrama de árbol de decisión puede ayudar. Si bien no es una bola de cristal, puede ofrecer información útil y valiosa para dirigirte en la dirección correcta. Uno de los mayores beneficios de un árbol de decisión es que puede eliminar las emociones de la ecuación.

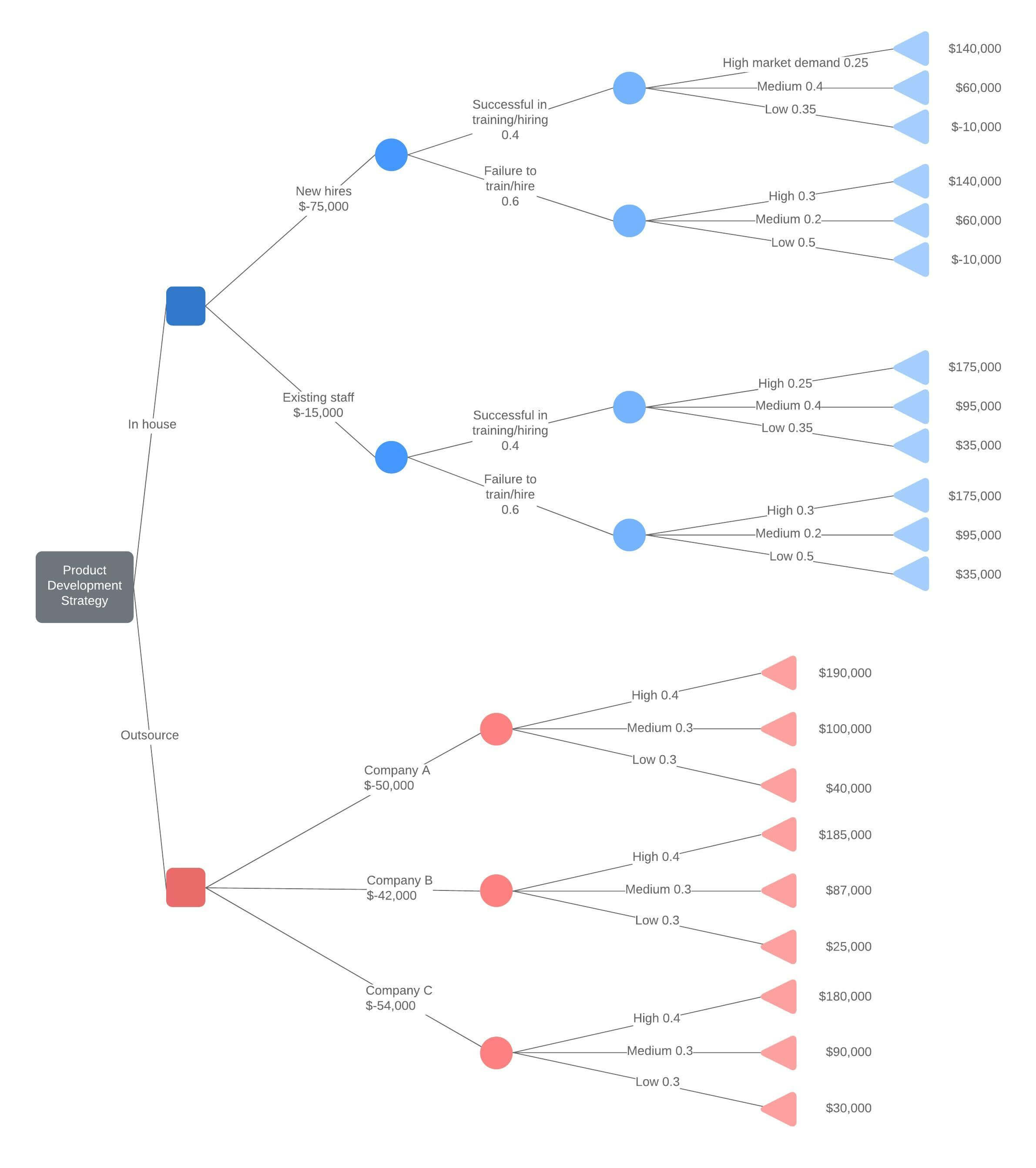

Los negocios a menudo usan diagramas de árbol de decisión para planificar una estrategia, analizar una investigación y arribar a ciertas conclusiones. Los prestamistas y los banqueros usan árboles de decisión para calcular el riesgo de los préstamos y de las oportunidades de inversión. También son una elección popular para las infografías, que aparecen con frecuencia en revistas o que se comparten en las redes sociales. El punto es que los árboles de decisión se pueden usar para evaluar casi cualquier pregunta o inquietud y visualizar posibles resultados.

Partes de un árbol de decision

Uno de los beneficios del diagrama de árbol de decisión es que no hay demasiados elementos. Los elementos clave se denominan "nodos" y se representan con un cuadrado o un círculo con ramas (líneas) que los conectan hasta lograr el resultado deseado. Los cuadrados indican decisiones, mientras que los círculos muestran resultados inciertos.

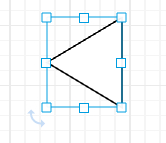

Los nodos tienen, como mínimo, dos ramas que se extienden hacia fuera. Escribe una solución posible en cada línea y conéctala al siguiente nodo. Continúa haciendo esto hasta que llegues al final de las posibilidades. Luego, dibuja un triángulo, este representará el resultado.

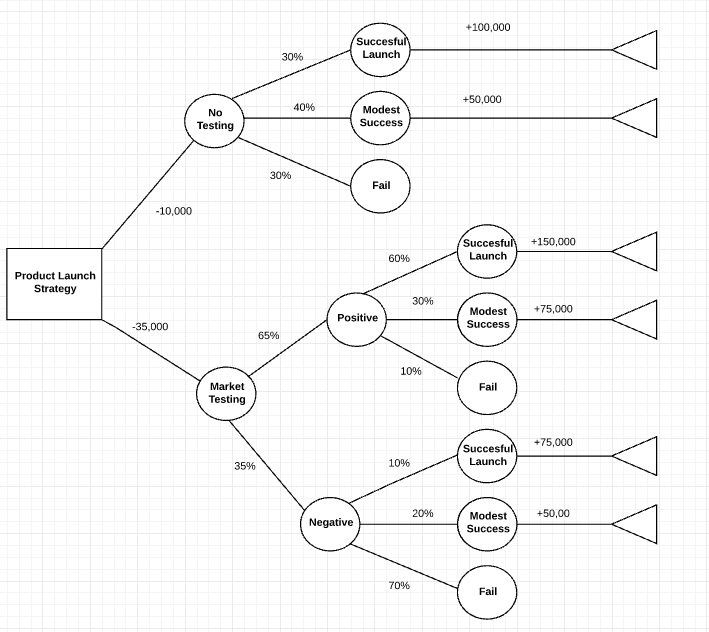

Una vez que hayas finalizado el diseño básico de un árbol de decisión, puedes agregar valores en cada línea para obtener más inteligencia. Puedes hacerlo del siguiente modo:

1. Observa cada línea y agrega una cantidad a cada una.

2. Para analizar tus opciones numéricamente, agrega un estimado para la probabilidad de cada resultado. Nota: Al agregar porcentajes, todas las líneas de un solo nodo deberán ser igual a 100; si usas fracciones, deben sumar 1.

3. Asigna una cantidad posible a cada triángulo al final de las ramas.

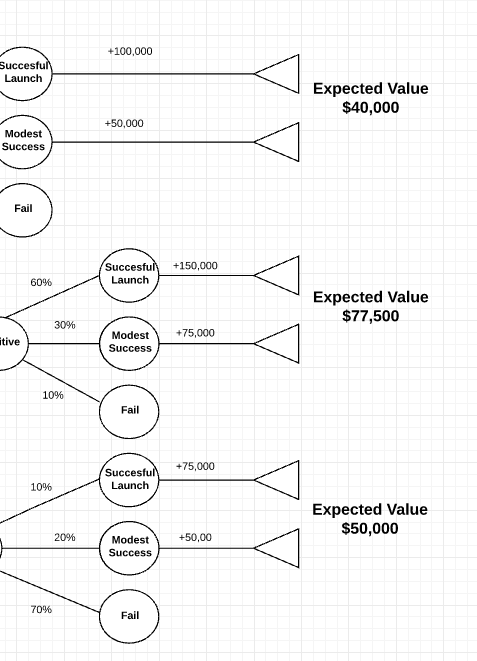

4. Calcula los resultados multiplicando el resultado por el porcentaje de probabilidad para cada rama final de ese resultado y resta el costo de ese curso de acción. Terminarás con un estimado de lo que podría dar ese resultado en particular.

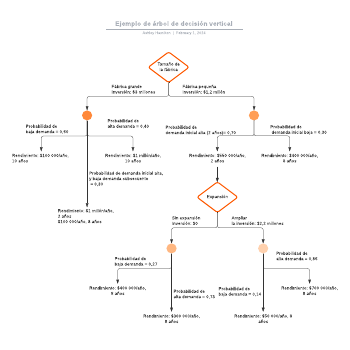

Este es un ejemplo:

Nota: Si tienes un árbol de decisiones grande con muchas ramas, calcula los números para cada cuadrado o círculo y registra los resultados para obtener el valor de esa decisión. Comienza por el lado derecho del árbol y continúa hacia el izquierdo.

Símbolos de los árboles de decisiones

| Figura | Nombre | Significado |

|---|---|---|

| Nodo de decisión | Indica una decisión que se tomará |

| Nodo de probabilidad | Muestra múltiples resultados inciertos |

| Ramificaciones alternativas | Cada ramificación indica un posible resultado o acción |

| Alternativa rechazada | Muestra una alternativa que no estaba seleccionada |

| Nodo terminal | Indica un resultado definitivo |

Cómo hacer un árbol de decisiones paso a paso

Para dibujar un árbol de decisión, primero debes elegir un medio. Puedes dibujarlo a mano en un papel o una pizarra, o puedes usar un software de árboles de decisión. En cualquier caso, te mostramos los pasos que debes seguir:

1. Comienza con la decisión principal. Dibuja un pequeño recuadro para representar este punto, luego dibuja una línea desde el recuadro hacia la derecha para cada posible solución o acción. Etiquétalas correctamente.

2. Agrega nodos de decisión y probabilidad para expandir el árbol del siguiente modo:

- Si otra decisión es necesaria, dibuja otro recuadro.

- Si el resultado es incierto, dibuja un círculo (los círculos representan nodos de probabilidad).

- Si el problema está resuelto, déjalo en blanco (por ahora).

Desde cada nodo de decisión, dibuja soluciones posibles. Desde cada nodo de probabilidad, dibuja líneas que representen los resultados posibles. Si deseas analizar tus opciones de forma numérica, incluye la probabilidad de cada resultado y el costo de cada acción.

3. Continúa con la expansión hasta que cada línea alcance un extremo, lo que significa que no hay más decisiones que tomar o resultados probables que considerar. Luego, asigna un valor a cada resultado posible. Puede ser una puntuación abstracta o un valor financiero. Agrega triángulos para indicar los extremos.

Con un árbol de decisión completo, ya estás listo para comenzar a analizar la decisión que enfrentas.

Ejemplo árbol de decisión

Al calcular la utilidad o el valor esperado de cada decisión en el árbol, puedes minimizar el riesgo y maximizar la probabilidad de obtener un resultado deseado.

Para calcular la utilidad esperada de una decisión, solo debes restar el costo de esa decisión a los beneficios esperados. Los beneficios esperados son iguales al valor total de todos los resultados que puedan derivar de esa decisión, y cada valor se multiplica por la probabilidad de que ocurra. A continuación te mostraremos cómo nosotros calcularíamos estos valores para el ejemplo descrito anteriormente:

Al identificar cuál es el resultado más deseable, es importante tener en cuenta las preferencias de utilidad del encargado de tomar la decisión. Por ejemplo, algunos prefieren opciones de bajo riesgo, mientras que otros están dispuestos a correr riesgos si el beneficio es mayor.

Al usar tu árbol de decisión acompañado por un modelo de probabilidad, puedes emplearlo para calcular la probabilidad condicional de un evento o la probabilidad de que suceda, en el caso de que otro evento ocurra. Para hacerlo, simplemente empieza con el evento inicial, luego sigue la ruta desde ese evento hasta el evento objetivo, y multiplica la probabilidad de cada uno de esos eventos juntos.

De este modo, un árbol de decisión se puede emplear como un diagrama de árbol tradicional, que traza las probabilidades de determinados eventos, como lanzar una moneda dos veces.

Ventajas y desventajas de un árbol de toma de decisiones

Los árboles de decisión siguen siendo populares por razones como las siguientes:

- Son muy fáciles de entender

- Pueden ser útiles con o sin datos fehacientes, y cualquier dato requiere una preparación mínima

- Se pueden agregar nuevas opciones a los árboles existentes

- Su valor al seleccionar la mejor de numerosas opciones

- Se combinan fácilmente con otras herramientas de toma de decisiones

Sin embargo, los árboles de decisión pueden volverse excesivamente complejos. En esos casos, un diagrama de influencia más compacto puede ser una buena alternativa. Los diagramas de influencia se enfocan en los objetivos, las entradas y las decisiones fundamentales.

Árboles de decisión en minería de datos y aprendizaje automático

Un árbol de decisión también puede usarse para ayudar a crear modelos predictivos automatizados, que puedan emplearse en el aprendizaje automático, la minería de datos y las estadísticas. Conocido como "el aprendizaje basado en árboles de decisión", este método toma en consideración las observaciones sobre un elemento para predecir su valor.

En estos árboles de decisión, los nodos representan datos en lugar de decisiones. Este tipo de árbol también se conoce como "árbol de clasificación". Cada ramificación contiene un conjunto de atributos o reglas de clasificación asociadas a una etiqueta de clase específica, que se halla al final de la ramificación.

Estas reglas, también conocidas como "reglas de decisión", se pueden expresar en una cláusula "Si... entonces...". Cada valor de datos o decisión forma una cláusula, de tal manera que, por ejemplo, "si las condiciones 1, 2 y 3 se cumplen, entonces el resultado X será el resultado definitivo con certeza Y".

Cada dato adicional ayuda a que el modelo prediga de forma más precisa a qué conjunto finito de valores pertenece el asunto en cuestión. Esa información se puede usar posteriormente como una entrada en un modelo más grande de toma de decisiones.

A veces la variable predicha será un número real, como un precio. Los árboles de decisión con resultados posibles, infinitos y continuos se llaman "árboles de regresión".

Para una mayor precisión, se suelen combinar múltiples árboles con métodos de ensamblado:

- Bagging (Ensamblado) crea múltiples árboles de decisión haciendo un remuestreo de los datos de origen, luego hace que los árboles voten para llegar a un consenso.

- Un clasificador de selva aleatoria consiste en múltiples árboles diseñados para aumentar la tasa de clasificación.

- Los árboles ampliados se pueden usar en árboles de clasificación y de regresión.

- Los árboles en una Selva aleatoria (Rotation Forest) se entrenan mediante el uso del análisis de componentes principales (ACP) en una porción aleatoria de los datos.

Un árbol de decisión se considera ideal cuando representa la mayor cantidad de datos con el menor número de niveles o preguntas. Los algoritmos diseñados para crear árboles de decisión optimizados incluyen CART, ASSISTANT, CLS y ID3/4/5. Un árbol de decisión también se puede generar mediante la creación de reglas de asociación, ubicando la variable objetivo a la derecha.

Cada método debe determinar cuál es la mejor forma de dividir los datos en cada nivel. Los métodos comunes para hacerlo incluyen la medición de la impureza de Gini, la obtención de información y la reducción de variaciones.

Emplear los árboles de decisión en el aprendizaje automático tiene numerosas ventajas:

- El costo del uso del árbol para predecir los datos disminuye con cada punto de datos adicional.

- Funciona para los datos numéricos o categóricos.

- Puede modelar problemas con múltiples resultados.

- Usa un modelo de caja blanca (lo que hace que los resultados sean fáciles de explicar).

- La fiabilidad de un árbol se puede cuantificar y poner a prueba.

- Tiende a ser preciso independientemente de si viola las suposiciones de los datos de origen.

Pero también tienen algunas desventajas:

- Cuando se presentan datos categóricos con múltiples niveles, la información obtenida se inclina a favor de los atributos con mayoría de niveles.

- Los cálculos pueden volverse complejos al lidiar con la falta de certezas y numerosos resultados relacionados.

- Las conjunciones entre nodos se limitan a AND, mientras que los gráficos de decisión admiten nódulos relacionados mediante OR.

Cómo se hace un árbol de decisiones en Lucidchart

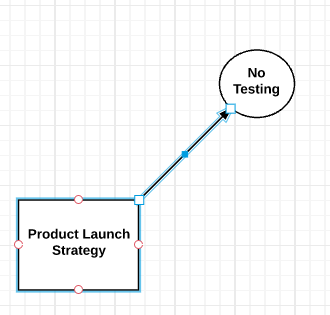

Usemos el árbol de decisión de Lucidchart para el lanzamiento de un producto y decidamos si tiene sentido invertir en las pruebas de mercado. Los diagramas de árbol de decisión contienen solo algunos símbolos (círculo, cuadrado, línea y triángulo), así que empezaremos uno desde cero. Inicia sesión en tu cuenta (si no tienes una, regístrate para probar Lucidchart de forma gratuita por una semana) y sigue los pasos siguientes.

1. Abre un documento en blanco

En la sección Documentos, haz clic en el botón naranja +Documento y luego haz doble clic.

Recomendación: También puedes hacer clic en la flecha hacia abajo naranja y elegir una plantilla de diagrama en blanco. Si usas esta opción, dirígete al paso 3.

2. Ajusta la configuración de la página

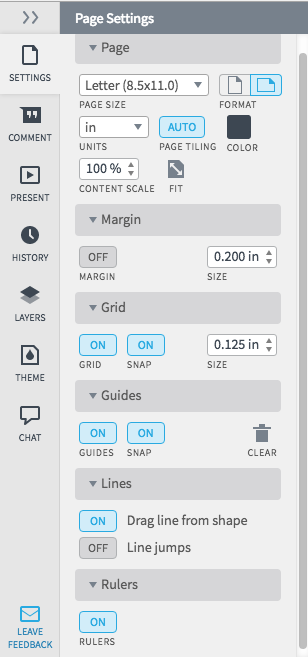

Al abrir un documento en blanco, en lugar de una plantilla, puedes cambiar la configuración de la página, márgenes, guías, cuadrículas, líneas y reglas. A la derecha, verás el menú de Configuración de página donde puedes realizar cualquier ajuste. Simplemente haz clic en las opciones que deseas y, una vez que hayas terminado, haz clic en las flechas que están al lado de Configuración de página para ocultar el menú. Ya que los árboles de decisión pueden volverse muy grandes, cambiaremos el formato de página a horizontal.

3. Escribe un nombre para el diagrama de árbol de decisión

Haz clic en el encabezado del diagrama en blanco en la parte superior de la pantalla y escribe un nombre para el archivo.

Nota: Si eliges una plantilla, se abrirá una pantalla emergente. Escribe el nombre de tu diagrama en el cuadro de texto y haz clic en Aceptar. El nuevo nombre aparecerá en la esquina superior izquierda de la pantalla.

4. Comienza a dibujar el árbol de decisión

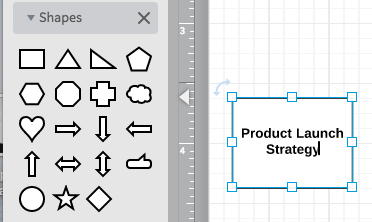

Haz clic y mantén apretado el rectángulo debajo de Figuras para arrastrarlo hacia el sector izquierdo de tu documento. Los árboles de decisión se dibujan de izquierda a derecha, así que ubícalo lo más cerca del margen que puedas. Usa la cuadrícula y la regla para alinear el rectángulo en el lugar que quieras. Escribe la decisión en el rectángulo.

Recomendación: Usa las opciones de formato de texto en la parte superior del diagrama para modificar las fuentes, los colores, el espaciado, etc.

5. Agrega nodos

Haz clic y arrastra un círculo al diagrama para agregar los nodos inciertos. Usa las cuadrículas para alinear los círculos en la página. Para modificar el tamaño del círculo, haz clic en el mismo, luego clic en un cuadrado azul y arrástralo para cambiar el tamaño. Escribe el nombre del resultado incierto dentro del círculo.

Puedes agregar todas las posibilidades que desees, pero necesitas un mínimo de dos opciones al crear un árbol de decisión. Continúa agregando nodos al árbol de decisión hasta lograr el resultado final de cada elección.

Recomendación: Si no quieres modificar el tamaño de todos los nodos (círculos), simplemente haz clic en un círculo existente y mantén presionado Command+C en el teclado. Luego mantén presionado Command+V para crear un círculo duplicado y arrástralo al lugar adecuado.

6. Agrega ramas al árbol de decisión

Para dibujar líneas entre los nodos, haz clic en la figura y mantén presionado uno de los círculos naranjas. Luego, arrastra la línea al siguiente nodo. Automáticamente se dibuja una flecha entre los dos objetos.

Recomendación: Para eliminar la punta de flecha de la línea, selecciona Sin punta desde la opción Extremos de líneas en la barra de menú superior.

Cuando llegues al final de una rama, donde no se necesiten otras decisiones en esa ruta, agrega un triángulo al final de esa fila.

7. Agrega probabilidades y valores al árbol de decisión

Es hora de que evalúes el árbol de decisión, así podrás estimar su valor si se obtiene un resultado determinado. Mira los círculos y agrega estimaciones sobre las probabilidades de cada resultado. Para agregar números al diagrama, haz clic en la letra T grande en las opciones Estándar y arrástrala al lugar donde deseas agregar un estimado.

Nota: Los porcentajes para cada nodo deberían ser igual a 100. Si utilizas fracciones, cada nodo debería sumar 1. No dudes en usar los datos existentes, en caso de tenerlos.

A continuación, agrega el costo de cada opción en la rama (línea de decisión).

8. Calcula el valor de cada decisión

Comienza por el lado derecho del árbol y trabaja hacia el izquierdo. Resta el costo de cada decisión de los beneficios previstos.

Una vez que hayas hecho los cálculos, verás claramente qué opción te brindará la mayor recompensa.

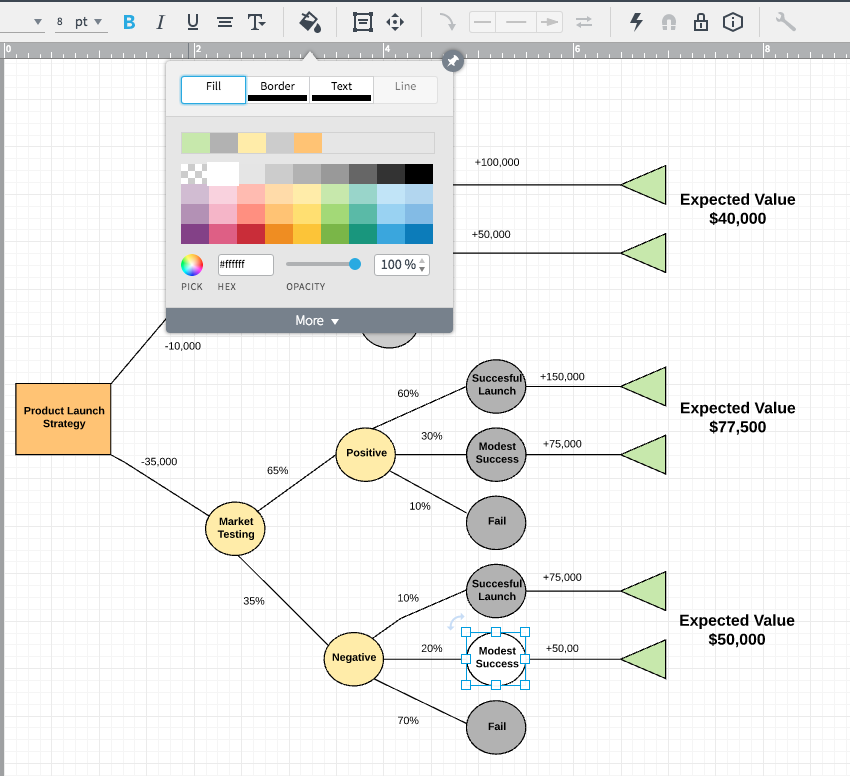

9. Agrega colores al árbol de decisión

Una vez que hayas finalizado el diseño básico de tu árbol de decisión, puedes agregar colores haciendo clic en un símbolo y, luego, haz clic en el ícono de relleno de color en la barra de menús y elige un color.

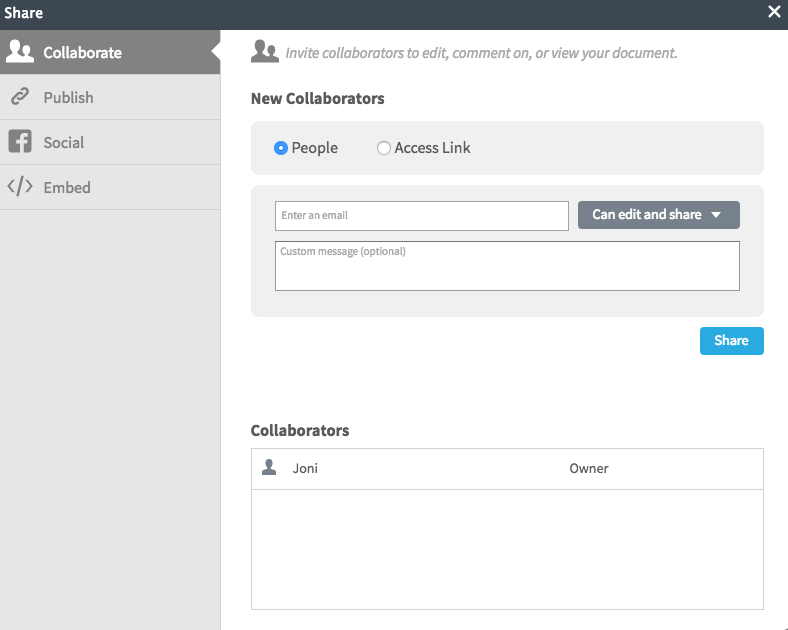

10. Comparte tu diagrama de árbol de decisión

Una vez que te guste el aspecto de tu árbol de decisión, puedes compartirlo con otras personas a través de correo electrónico, enlaces, redes sociales (Facebook, Twitter, Google+ y LinkedIn) o puedes incrustarlo en un sitio web. Haz clic en el botón azul Compartir en la parte superior derecha de la pantalla y aparecerá una pantalla emergente. Elige cómo te gustaría compartir el diagrama e ingresa la información apropiada.

Cuando agregas un colaborador enviando un enlace por correo electrónico al árbol de decisión, puedes trabajar en el diagrama de forma simultánea y usar la función de chat para mantener conversaciones.